Aujourd’hui, une photo qui fait le buzz peut être sortie d’un boîtier haut de gamme… ou d’un prompt tapé en trente secondes. Entre deepfakes politiques et mèmes fabriqués, il devient vital – et franchement amusant – de démêler le vrai du bidon. La bonne nouvelle ? Pas besoin d’être expert en cryptographie : avec cinq réflexes grands publics et deux minutes chrono, vous pouvez jeter un verdict fiable à 90 %. On vous montre.

Ouvrez grand les yeux et observez

La perception humaine reste, contre toute attente, l’outil le plus performant contre les faux visuels. Prenez quelques secondes pour agrandir la photo :

- Zoomez autant que possible : Sur smartphone, effectuez un pincement jusqu’à saturation ; sur ordinateur, ouvrez l’image dans un nouvel onglet et multipliez les Ctrl +.

- Cherchez les anomalies anatomiques : Les générateurs progressent mais les mains continuent de les trahir : nombre de doigts incohérent, phalanges soudées, bagues qui se chevauchent, proportions irréalistes entre la paume et le visage. Dans nos tests, 7 images sur 10 produites par Stable Diffusion ou Midjourney laissent au moins un de ces défauts.

- Scrutez le texte présent dans l’image : Panneaux de signalisation, slogans sur des t‑shirts, numéros de rue : l’IA peine à former des caractères exacts. Les lettres se doublent, se tordent ou disparaissent partiellement. C’est un signe presque imparable.

- Inspectez l’arrière‑plan : Un horizon qui gondole, une perspective qui se dérobe, un motif de carrelage qui se répète comme un papier peint : autant d’indices qu’un algorithme a « inventé » plutôt que photographié.

Pourquoi cela fonctionne‑t‑il ? Tout simplement parce que, pour réduire le temps de calcul, les modèles suppriment ou lissent une partie du bruit aléatoire présent dans une photo réelle. Résultat : vos yeux, qui ont appris depuis l’enfance à distinguer les textures complexes du monde physique, repèrent instinctivement ce manque de variété.

Anomalie anatomique flagrante : L’index de la main droite dépasse légèrement le majeur. En général, le majeur est plus long que l’index ce qui trahit ici une génération IA.

Texte incohérent : Le panneau affiche « I ❤️ ITALDY » au lieu de Italy ; l’orthographe erronée est typique des modèles qui peinent à dessiner des lettres.

Arrière-plan cloné : Le groupe de visiteurs derrière la jeune femme présente plusieurs silhouettes quasi identiques (mêmes vêtements, mêmes visages), signe de duplication automatique.

Prise en main artificielle : Le carton semble « collé » contre la paume : on ne voit ni pression du pouce ni légère déformation du bord, ce qui trahit un rendu synthétique.

Passez l’image à la loupe numérique

Les métadonnées EXIF

Chaque cliché pris par un appareil photo ou un smartphone inscrit automatiquement des informations techniques (date, marque, vitesse d’obturation, coordonnées GPS…) dans ce qu’on appelle les métadonnées EXIF. Les images créées par IA, elles, n’ont pas d’appareil photo… ou trichent en inscrivant un faux profil. Le test est ultra‑simple :

- Téléchargez l’image suspecte sur votre ordinteur.

- Allez sur un site de vérification de données EXIF (comme EXIFdata.com ou Jimpl, par exemple) et faites glisser le fichier dans la fenêtre.

- Si vous voyez apparaître une ligne du genre « Apple iPhone 15 Pro – ƒ/1.8 – 1/200 s – ISO 125« , il y a de fortes chances que la photo vienne d’un capteur réel.

- Si, au contraire, le champ Software indique « Stable Diffusion 3.0 » ou si tous les champs sont vides, vous tenez déjà un premier indice de synthèse.

Important : quelqu’un de déterminé peut effacer les métadonnées. Mais dans la pratique, la majorité des images IA relayées à chaud conservent ce vide béant, par négligence ou ignorance.

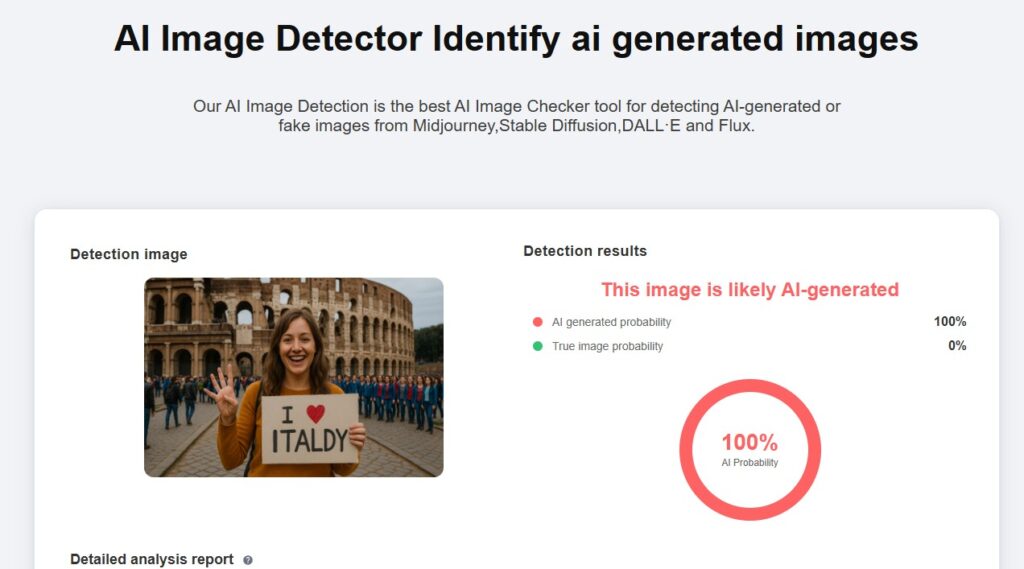

Les détecteurs d’IA gratuits

Les services en ligne de détection d’image générée par IA sont nombreux, mais en voici deux que vous pouvez tester ou combiner.

- Brandwell AI Image Detector. Uploadez votre image pour obtenir très rapidement une probabilité de génération par une IA ou un humain.

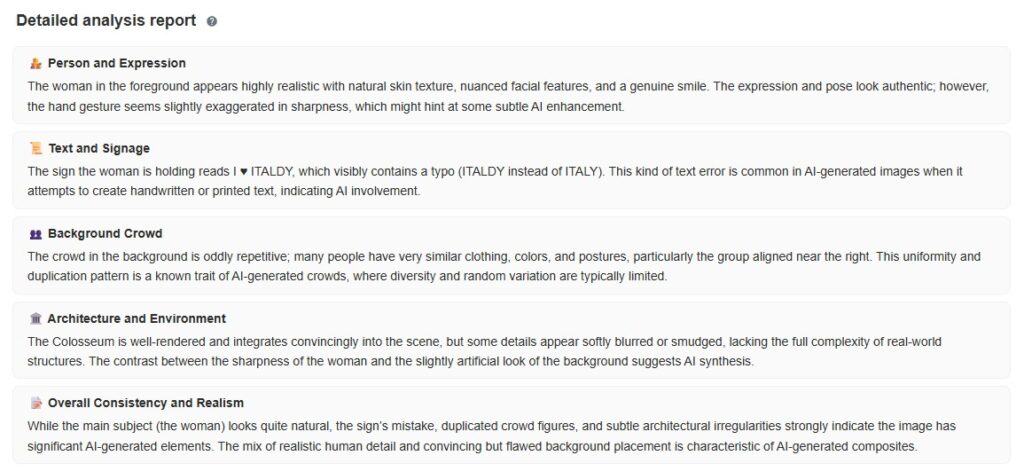

- Decopy AI Image Detector. Le plus efficace des deux selon mes tests. Vous uploadez l’image et l’algorithme retourne un pourcentage de probabilité. En plus de cela, l’outil vous propose un rapport détaillé qui explique la note.

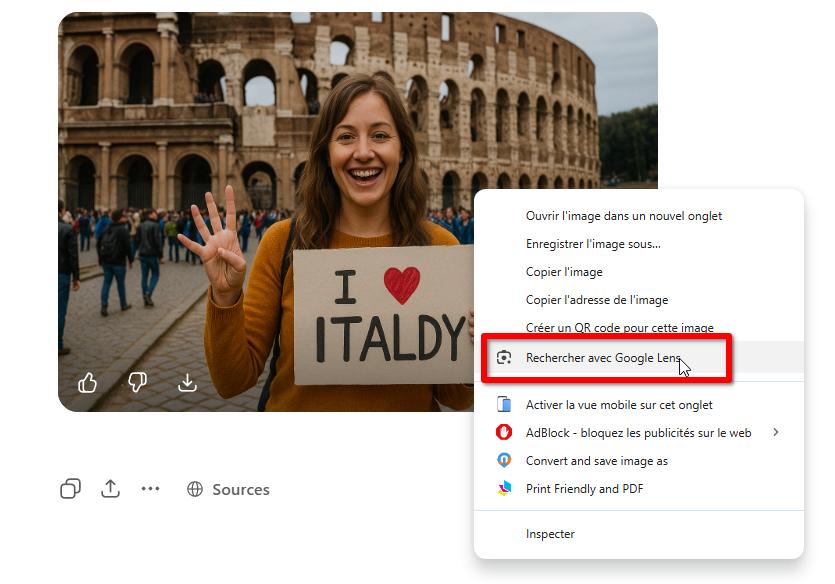

Recoupez avant de partager

Tout contenu visuel légitime laisse des traces sur le web : sites d’information, réseaux sociaux, banques d’images. Pour vérifier qu’une photo a bel et bien une existence antérieure :

- Clic droit sur l’image dans Chrome ou Edge > Rechercher cette image avec Google Lens.

- Sur mobile, ouvrez l’application Google Lens, importez l’image et observez les résultats.

- Analysez la chronologie : si le premier résultat daté remonte à l’année dernière, la photo est probablement authentique. Si elle apparaît pour la première fois très récemment et uniquement sur un compte X ou TikTok, son origine est plus que douteuse.

Assemblez les indices : la méthode du faisceau de présomptions

Un seul signe ne suffit jamais. Prenez l’habitude de croiser au moins deux techniques parmi celles listées ci‑dessus :

- Des artefacts visuels manifeste + métadonnées absentes => IA

- Un score de 92 % “IA” sur AI or Not + aucune trace dans Google Lens => IA

- Un panneau de texte illisible + un message SynthID en rouge => IA

À chaque fois que deux indices convergent, la fiabilité de votre diagnostic grimpe en flèche.

Les algorithmes de génération d’images évoluent à grande vitesse, mais notre esprit critique aussi. En combinant la vigilance visuelle, la lecture rapide des métadonnées et l’aide d’outils gratuits, vous transformez une session de scroll en exercice de vérification éclair. À vous de jouer : la prochaine fois qu’une photo « trop belle pour être vraie » surgit dans votre fil, testez ces cinq réflexes, partagez votre verdict, et contribuez à un web un peu plus sain.

Et si vous voulez vous entrainer, vous pouvez jouer à Real or Not, un jeu qui vous défie de distinguer les photos IA de photos réélles.