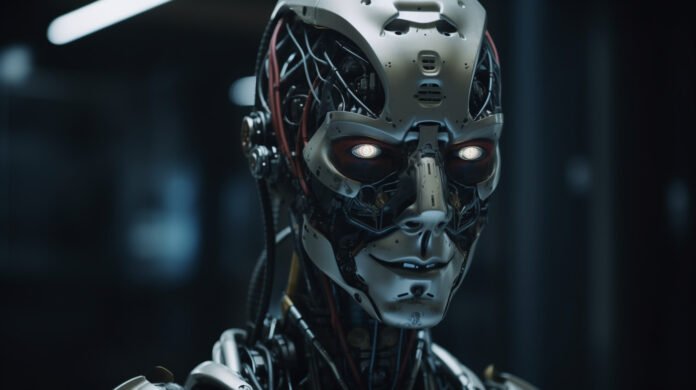

Il y a quelques années, le développement de l’intelligence artificielle était décrit exclusivement en couleurs irisées. Des experts de divers domaines ont imaginé comment il pourrait aider les médecins, les traducteurs et les représentants de nombreuses autres professions.

Cependant, dès que le modèle de langage GPT a fait de tels progrès que les textes qu’il a créés sont devenus presque impossibles à distinguer des textes écrits par de vraies personnes, l’attitude envers l’intelligence artificielle (IA) a radicalement changé.

Même des chercheurs clés de ce domaine ont rejoint les opposants radicaux à cette technologie. Tandis que les cybercriminels profitent des réalisations du GPT, les experts avertissent sur l’intelligence artificielle. Elle peut créer des problèmes beaucoup plus graves qui menacent la vie sur Terre en tant que telle.

L’intelligence artificielle veut sortir d’Internet

La poursuite du développement de l’intelligence artificielle peut mettre un terme au développement de l’humanité. Tôt ou tard, les réseaux de neurones super intelligents iront au-delà d’Internet. Ils prendront le contrôle de tout le système planétaire et se débarrasseraient des humains. Cela paraît être un texte tout droit sorti d’un livre de science-fiction ? C’est pourtant la déclaration d’un éminent scientifique. Eliezer Yudkowsky, cofondateur de l’Institute for the Study of Machine Intelligence, est l’un des principaux experts en informatique de notre époque. Il a fait part de cette prévision dans une chronique pour Time magazine. Sa proposition est d’arrêter complètement toute recherche dans ce domaine. À l’exception de celles qui permettront d’éviter la mort de l’humanité.

“Le principal danger est la perspective de créer non pas un tel intellect qui rivalise avec l’humain, mais un qui surpasse l’humain. Sur ce chemin, les frontières éthiques sont très peu visibles. Les chercheurs peuvent les franchir par eux-mêmes sans se faire remarquer. Par conséquent, le résultat le plus probable de la création d’une IA super intelligente sera que littéralement tous les habitants de la Terre mourront. Pas dans le sens de « il y a une perspective lointaine de cela ». Mais dans le sens de « il est absolument évident que cela se produira », a écrit Yudkowsky.

Il est certain que l’intelligence artificielle ‘surhumaine’ ne se souciera ni des gens ni de la vie intelligente en général. Les réseaux de neurones indifférents seront guidés non par des émotions qui leur sont inconnues, mais par leurs propres besoins. Ces derniers peuvent inciter la machine à utiliser le corps humain à ses propres fins.

« Pour visualiser une IA surhumaine hostile, imaginez toute une civilisation extraterrestre. Cette dernière pense des millions de fois plus vite qu’un humain. Cet IA vit dans un monde de créatures qui, de son point de vue, sont très stupides et très lentes. » a suggéré Yudkowsky en expliquant ce à quoi ressemblera l’IA.

Yudkowsky suggère également de penser que l’intelligence artificielle peut aller au-delà d’Internet si elle le souhaite. Ses hypothèses ressemblent à une scène de film de science-fiction. Les machines apprendront à voler l’ADN déchiffré d’un individu. Elles apprendront à créer des formes de vie artificielles à partir de cet ADN. Ou même à organiser une production moléculaire post-biologique, dans laquelle elles pourront réassembler une substance en une substance complètement différente.

Arrêter ce développement

Les inquiétudes de Yudkowsky sont venues en réponse à une lettre publiée fin mars par The Future of Life. L’organisation à but non lucratif étudie les phénomènes qui constituent une menace existentielle pour l’humanité. Au milieu de la dernière décennie, l’entrepreneur informatique américain Elon Musk, qui a lancé ce projet d’IA, est également devenu l’un des principaux signataires d’une lettre sur l’avenir de l’IA. Mais il n’est pas le seul. Plus de dix mille personnes ont laissé leurs autographes virtuels sous le texte. Ils comprenaient le cofondateur d’Apple, Steve Wozniak, l’un des principaux historiens et écrivains récents, Yuval Noah Harari, et des dizaines de chercheurs bien connus en intelligence artificielle. Le message principal du document est similaire aux thèses de Yudkowsky. La lettre déclare que l’intelligence artificielle apportera les changements les plus profonds dans la vie des gens. Et donc son développement doit être géré. Mais puisque personne ne le fait, un moratoire sur le développement ultérieur est nécessaire.

“Si quelqu’un crée une IA trop puissante dans les conditions actuelles, je pense que peu de temps après, chaque membre de la race humaine et toute vie biologique sur Terre disparaîtront. Si nous continuons ainsi, tout le monde mourra, y compris les enfants” a déclaré Yudowski.

Doit-on automatiser tous les métiers, y compris ceux des décideurs? Devrions-nous développer des esprits non humains qui pourraient éventuellement nous dépasser en nombre, nous surpasser et nous remplacer ? Devrions-nous risquer de perdre le contrôle de notre civilisation? »

La proposition des auteurs de la lettre est de suspendre la formation des systèmes intelligents pour les six prochains mois. Yudkowsky, dans une déclaration en réponse, estime qu’un tel moratoire devrait durer au moins 30 ans. Selon Musk et d’autres signataires, aucun des réseaux de neurones ne devrait devenir plus intelligent que GPT-4. Et ce, au cours des six prochains mois. C’est la sortie d’une nouvelle version de la société OpenAI qui est devenue la raison formelle de la publication du document.

GPT se développe trop vite

Au cours des dernières semaines, non seulement les représentants de la communauté des experts, mais aussi les autorités des différents pays ont prêté attention au sujet du développement rapide des réseaux de neurones.

Même Europol s’est inquiété de la situation. Il a mis en garde contre les risques potentiels pour le cyberespace qui découlent des modèles d’IA déjà existants.

Les responsables de la sécurité craignent, en particulier, que les réseaux de neurones puissent contourner les programmes de sécurité et aider à organiser des cyberattaques, aider à former les cybercriminels à de nouvelles tactiques, ou même générer un code malveillant unique.

Europol admet que certaines de ces informations sont déjà sur Internet. Mais le même ChatGPT peut les trouver en quelques secondes, et non en jours et en mois.

Les arguments contre

Les principaux arguments des opposants à la mise en œuvre massive de ChatGPT sont liés au fait que cette technologie viole la confidentialité. Et, l’absence de base légale pour l’utilisation des informations des utilisateurs. Entre autres plainte, l’impossibilité de vérifier l’âge de l’utilisateur, malgré la restriction formelle de l’utilisation de ChatGPT pour les moins de 13 ans. Pour la communauté européenne, où des règles assez strictes pour l’interaction de l’État et des entreprises avec les données personnelles des citoyens sont en vigueur depuis plusieurs années, une telle imperfection est devenue un non-sens.